硬功夫的巅峰,亚马逊云科技获云原生基础设施技术能力评估最高分 原创

企业在谈数字化转型和上云时,都绕不开云原生这个话题。

云原生在十年间迅速发展,对IT基础设施、应用架构和应用开发模式带来了深刻改变。中国信通院云计算与大数据研究所所长何宝宏曾说,云原生作为云计算演进的重要方向,是企业数字化转型的核心驱动,是数字经济发展的重要信息基础设施,是建设数字中国的关键创新引擎。

但企业在推动云原生应用时,传统的基础设施却往往显得力不从心,这也驱动了基础设施加速云原生化。IDC预测,到2024年,云原生的工作负载将会占据服务器上工作负载的1/3。

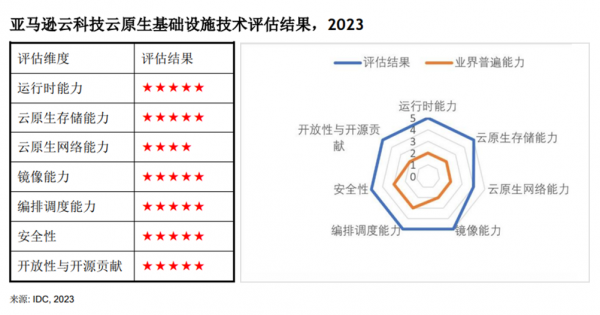

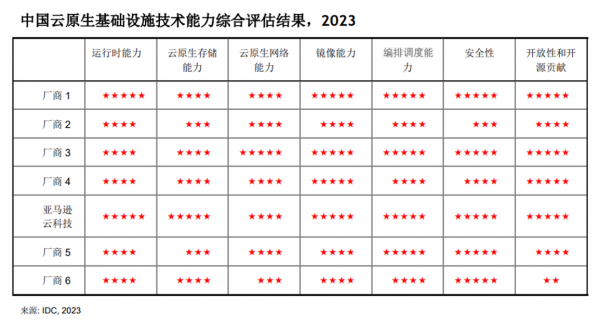

最近IDC也发布了《中国云原生基础设施技术能力评估报告,2023》,将云计算环境下为支持容器化应用程序、微服务架构和DevOps而设计的新型基础设施定义为云原生基础设施,并设立了7个维度进行评估,包括运行时、云原生存储、云原生网络、镜像、编排调度、安全性、开放性与开源贡献。

亚马逊云科技获得最高分,不但是“云原生存储能力”维度唯一获得满分的厂商,而且在多个维度获得满分,堪称云原生基础设施领域的全能型选手。

云原生技术创新前沿

云原生一直被认为是云计算的下一个未来。

IDC认为,云原生基础设施在提升企业效率、降低成本以及促进创新方面存在巨大潜力。在未来几年内,云原生基础设施应用规模将更加广泛,并将成为企业数字化转型的重要驱动力。

从云计算诞生到今天,亚马逊云科技创新的步伐就从未停止,亚马逊云科技在《中国云原生基础设施技术能力评估报告,2023》的各技术评估维度均大幅领先业界。

亚马逊云科技一直在不断突破技术的边界,在算力逐渐成为瓶颈的环境下,其在自研新品上已经投入十多年,拥有Nitro、Graviton、人工智能机器学习自研芯片三条产品线。去年2023 re:Invent 全球大会上,亚马逊云科技推出了最新的Amazon Graviton4和Amazon Trainium2自研芯片。Graviton4与当前一代Graviton3处理器相比,性能提升高达30%。Trainium2与第一代Trainium芯片相比训练速度提升多达4倍。

去年基于自研芯片Amazon Graviton3处理器的M7g通用型、C7g计算优化型和R7g内存优化型三款实例已经在中国落地,这些实例都是基于Amazon Nitro System构建。亚马逊云科技也在同合作伙伴合作,提供基于AMD、Intel以及英伟达等的最新芯片和实例组合,包括600多种广泛而深入的计算实例选择。

同时亚马逊云科技的优势还体现在全球化,亚马逊云科技的基础设施遍及全球33个地理区域的105个可用区,并已公布计划在马来西亚、墨西哥、新西兰和泰国等新建5个区域、15个可用区。

除了区域和可用区之外,亚马逊云科技还为高密度城市推出了更低延迟的38个Amazon Local Zones本地扩展区和29个Amazon Wavelength区域。

云原生存储能力唯一满分

在亚马逊云科技众多服务中值得一提的是存储服务,此次也是“云原生存储能力”维度唯一获得满分的厂商。从2006年正式成立以来推出的第一款云服务Amazon Simple Storage Service(S3)对象存储服务,18年来已经构建起云存储“全家桶”,形成丰富的对象、文件和数据块存储,数据迁移,混合云存储及边缘计算,托管式文件传输,灾难恢复和备份服务,引领云原生存储领域的技术潮流。

2023 re:Invent还推出了Amazon S3 Express OneZone,为高性能存储需求的用户提供了新的存储层级选择。与Amazon S3 Standard 相比,Amazon S3 Express One Zone的数据访问速度提高至多10倍,数据请求成本降低50%,为机器学习训练和推理、交互式分析以及媒体内容创建等请求密集型工作负载提供最高性能存储。

亚马逊云科技还“专门构建”了丰富的Amazon FSx文件存储系列服务,为Windows工作负载推出的Amazon FSx for Windows File Server,为计算密集型工作负载推出的Amazon FSx for Lustre,为企业业务迁移上云推出的Amazon FSx for NetApp ONTAP和为大数据分析Linux工作负载推出的Amazon FSx for OpenZFS。

亚马逊云科技还是除了计算、存储、应用集成、数据库,亚马逊云科技也是首个数据分析服务全部实现Serverless的云供应商,助力不同技术偏好和业务需求的客户加速进行云原生应用创新。

2023 re:Invent还宣布了3项数据库和应用领域的Serverless创新,Amazon Aurora Limitless 数据库可跨多个 Amazon Aurora Serverless 实例自动分发和查询数据,并能够扩展到每秒百万次的事务级写入并管理PB级数据。Amazon ElastiCache Serverless 可以帮助客户在一分钟内创建高可用的缓存,并实时进行垂直和水平扩展以支持客户复杂的应用程序,且无需管理基础架构。Amazon Redshift Serverless 利用人工智能(AI)预测工作负载并自动扩展和优化资源,帮助客户实现高性价比的目标。

云原生简化生成式AI应用开发

IDC预测,到2024年,新增的生产级云原生应用在新应用的占比将从2020年的10%增加到60%。亚马逊云科技也在提供丰富的开发工具和模型选择,确保基于云原生的程序快速开发与产品迭代。

现在云原生正逐渐与应用、大模型相结合。亚马逊云科技在生成式AI领域已经建立起三个层级的全栈生成式AI能力,上层是构建生成式AI的应用层,中间层是微调模型需求的工具服务,最底层是训练和推理的基础设施层。

应用层,2023 re:Invent最新推出的Amazon Q是业界第一个专门针对企业业务场景,可以量身定制的生成式AI助手,基于企业内部数据帮助企业解决问题。

中间层,自2023年4月Amazon Bedrock发布以来就备受关注,它是一款Serverless服务,开发人员无需管理任何的基础设施和配置,即可以云原生的方式快速进行生成式AI应用的开发。2023 re:Invent上Amazon Bedrock也对两个模型进行了升级,并发布了模型的微调、检索增强生成,以及基于Amazon Titan大模型的预训练功能。另外Agents for Amazon Bedrock也正式可用,它能够理解用户请求,将复杂任务分解为多个步骤,而且是自动和托管的。

底层,除了推出专为训练人工智能系统而设计的第二代芯片Amazon Trainium2。亚马逊云科技CEO Adam还携手英伟达CEO黄仁勋扩大战略合作,成为首家推出NVIDIA GH200 NVL32实例的云厂商。

同时Amazon SageMaker推出五项新功能,助力规模化开发应用模型。Amazon SageMaker HyperPod可大规模加速基础模型训练,能够缩短高达40%的训练时间,并可以确保持续数周或数月的训练过程不中断;Amazon SageMaker Inference推理功能可平均降低50%的部署成本和20%的推理延迟;Amazon SageMaker Clarify可以帮助客户评估、比较和选择最佳模型;Amazon SageMaker Canvas的两项增强功能,用自然语言指令准备数据、利用模型进行大规模业务分析,将使客户能够更轻松、更快速地将生成式AI集成到他们的工作流程中。

未来应用开发如何用好云原生,来实现更多上层应用的现代化的服务,是云原生未来发展的一个重点。当然企业需深刻理解云原生对于数字化转型的业务价值,这样才能充分释放其潜力,实现真正的技术突破和业务创新。

好文章,需要你的鼓励

超越能源使用:数据中心可持续运营策略

随着AI广泛应用推动数据中心建设热潮,运营商面临可持续发展挑战。2024年底美国已建成或批准1240个数据中心,能耗激增引发争议。除能源问题外,服务器和GPU更新换代产生的电子废物同样严重。通过采用模块化可修复系统、AI驱动资产跟踪、标准化数据清理技术以及与认证ITAD合作伙伴合作,数据中心可实现循环经济模式,在确保数据安全的同时减少环境影响。

剑桥大学突破性研究:如何让AI在对话中学会真正的自信判断

剑桥大学研究团队首次系统探索AI在多轮对话中的信心判断问题。研究发现当前AI系统在评估自己答案可靠性方面存在严重缺陷,容易被对话长度而非信息质量误导。团队提出P(SUFFICIENT)等新方法,但整体问题仍待解决。该研究为AI在医疗、法律等关键领域的安全应用提供重要指导,强调了开发更可信AI系统的紧迫性。

2026年超大规模数据中心运营商发展前瞻:全球最大数据中心运营商的未来走向

超大规模云数据中心是数字经济的支柱,2026年将继续保持核心地位。AWS、微软、谷歌、Meta、甲骨文和阿里巴巴等主要运营商正积极扩张以满足AI和云服务需求激增,预计2026年资本支出将超过6000亿美元。然而增长受到电力供应、设备交付和当地阻力制约。截至2025年末,全球运营中的超大规模数据中心达1297个,总容量预计在12个季度内翻倍。

威斯康星大学研究团队破解洪水监测难题:AI模型终于学会了“眼观六路“

威斯康星大学研究团队开发出Prithvi-CAFE洪水监测系统,通过"双视觉协作"机制解决了AI地理基础模型在洪水识别上的局限性。该系统巧妙融合全局理解和局部细节能力,在国际标准数据集上创造最佳成绩,参数效率提升93%,为全球洪水预警和防灾减灾提供了更准确可靠的技术方案。

埃森哲收购英国AI公司Faculty 强化决策智能服务

亚马逊CES发布全新Fire TV界面与Artline彩色边框电视

联想推出跨设备AI智能体,挑战微软和谷歌

麦肯锡和General Catalyst高管:AI时代终结"一次学习,终身受用"模式

联想以AI和数字孪生技术助力2026世界杯

针对D-Link路由器严重远程代码执行漏洞的持续攻击活动

联想Qira AI助手跨设备工作,摩托罗拉AI别针展新机

Deno 2.6新增dx工具运行NPM和JSR二进制文件

西门子CES 2026发布多项技术,加速工业AI革命

Littelfuse推出适用于电动汽车电池、电机和安全系统的汽车级电流传感器

CES 2026 | 机器人开发的“ChatGPT时刻”已到 老黄定调“物理AI”的路线图

超越能源使用:数据中心可持续运营策略