靠谱、高效的构建AI Agent实操手册!re:Invent 2025 Swami博士主题演讲划重点!

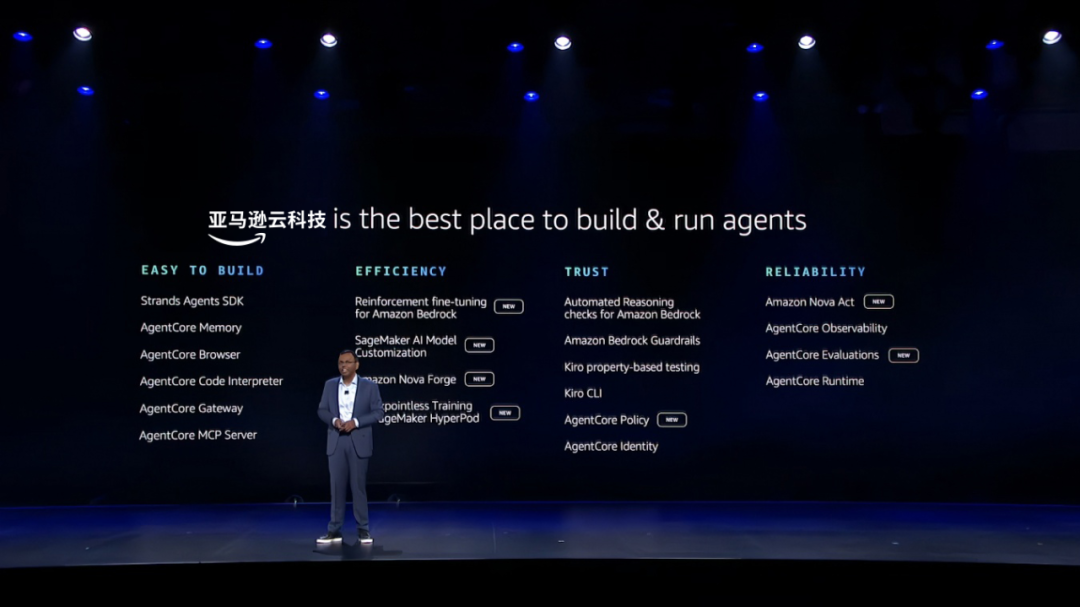

北京时间2025年12月4日,亚马逊云科技re:Invent 2025进入第三天,亚马逊云科技Agentic AI副总裁Swami Sivasubramanian发表主题演讲《Agentic AI的未来已来》,系统阐述构建可靠AI Agent的核心技术路径,并围绕“易于构建(Easy to Build)、高效(Efficiency)、可信(Trust)、可靠(Reliability)”四大支柱发布多项重磅创新。其中,Amazon Nova Act服务的可靠性达到90%,Amazon Bedrock强化微调功能准确性提升66%,Amazon Nova Forge开创“开放训练模型”新模式。

Swami博士开场以自己的高中编程经历唤起共鸣:“还记得第一次编程的成就感、自由感吗?今天,AI Agent让全球开发者重获这种体验。”他进一步指出,AI Agent正从“技术奇迹”转变为能提供业务价值的实用工具,核心转变源于两大突破:第一,开发门槛降低,开发者可用自然语言构建,无需记住数百个API参数;第二,开发速度显著提升,开发周期从数年或数月缩至几周甚至几天。然而,Swami博士也直言不讳地指出了一个残酷的现实:大多数企业正陷入“概念验证监狱”(POC Jail),无数精彩的Agent原型无法走向生产环境。

如何打破这个困局?Swami博士清晰地展示了答案,正是围绕“易于构建、高效、可信、可靠”四大支柱构建生产级AI Agent。

Easy to Build

解决五大生产挑战

Swami博士表示,传统Agent开发需预设所有场景流程,不仅代码难维护,还易因意外失败,且多数概念验证未考虑快速部署能力、复杂的内存系统、身份访问管理、工具连接、可观测性等生产五大障碍。

亚马逊云科技的解决方案是双管齐下。

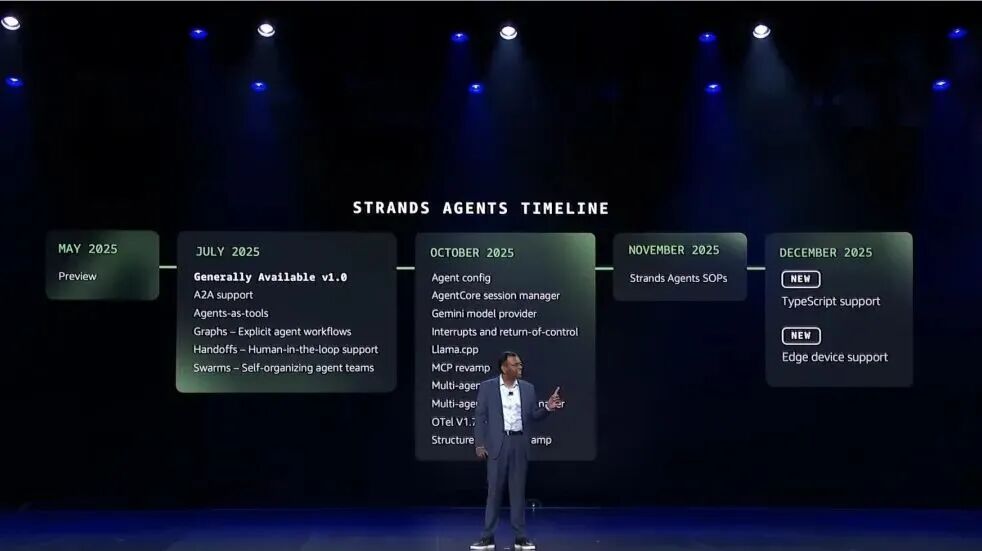

首先是亚马逊云科技推出的开源Agent开发框架Strands Agents SDK。它打破传统模式,以模型驱动为核心,无需预定义工作流,让模型能自主适配各类实际场景。这一能力已在亚马逊云科技内部得到充分验证,不仅帮团队省去了数千行冗余代码,还显著提升了项目的准确性与可维护性。自今年5月开启预览以来,Strands Agents SDK的受欢迎程度超出预期,下载量已轻松突破500万次。

今日新增的两项核心能力更让它如虎添翼:TypeScript支持将Strands Agents SDK扩展到全球最流行的编程语言之一,大幅降低开发者的接入门槛;而边缘设备支持则解锁了汽车、游戏、机器人等领域的全新场景,让自主AI Agent能在边缘运行。

但仅有好的开发框架还不够。Swami博士强调,从概念验证(PoC)到生产的鸿沟需要一个托管系统来填补。Amazon Bedrock AgentCore正是为此而生。在现场演示中,Swami博士展示了AgentCore Identity的强大能力:AgentCore Identity仅需几行代码,即可实现跨亚马逊云科技应用与Slack、Zoom等第三方服务的身份访问管理,而从零构建同样的能力,则需花费数周。

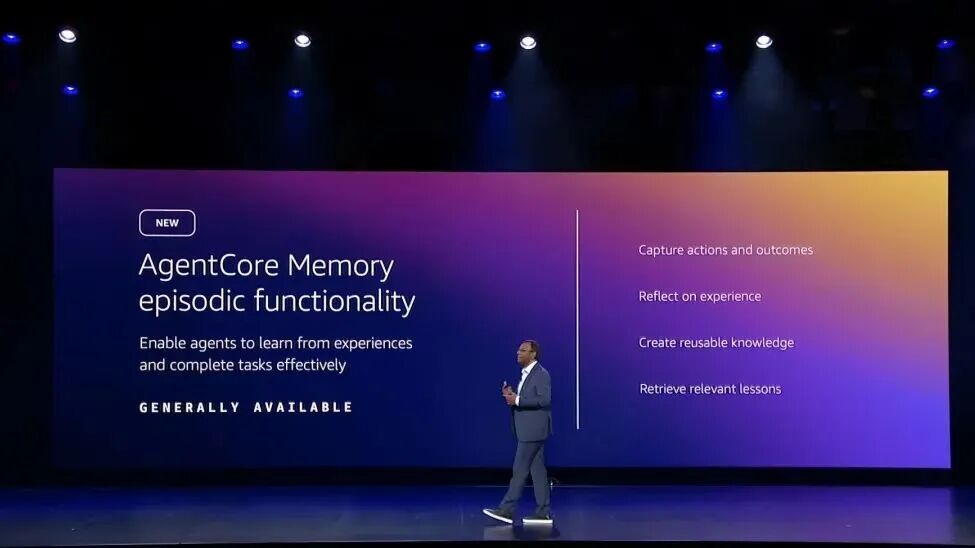

今天发布的Episodic Memory进一步升级Agent能力。Swami博士以旅行助手为例解释其价值,当你独自出差时,Agent会预订航班起飞前45分钟到达机场的专车,这对于独自出行足够了;但当你带着两个孩子和大量行李时,情况就完全不同了。如果只记住“用户需专车”这个需求,Agent仍会按45分钟安排。而有了Episodic Memory,Agent会记住上次家庭旅行时,孩子们因找玩具、行李箱重、安检排队长等混乱情况耽误了出行时间,因此会自动将到达时间调整为2小时。这不仅是记住过去,更是理解行为背后的“什么时候”与“为什么”,Agent经验越丰富,就会变得越聪明。

此外,昨日还发布了两项AgentCore的新能力,其中Policy in Amazon Bedrock AgentCore提供对Agent行为的控制,同时保留Agent推理和采取最佳行动的自由,而AgentCore Evaluations则让开发者能在数千个模拟场景中评估和测试Agent,确保它们在上线前就达到生产级标准。

Efficiency

模型定制化的关键路径

Swami博士接着将话题转向了效率。他指出,现成的大模型虽然智能,但并不总是最高效。效率不仅仅关乎成本,还关乎三个关键维度:延迟即响应速度、规模即峰值处理能力、敏捷性即迭代速度。他用一个简单的观察来说明问题:大多数Agent将时间花在编写代码、分析搜索结果、创建内容、执行预定义工作流等常规操作上,如果能为这些任务定制模型,就能大幅提升效率。

但高级定制技术如强化学习的门槛极高,需博士级专业知识、复杂分布式基建,且开发周期长达6-12个月。Swami博士介绍了四种定制方案:监督微调、模型蒸馏、人类反馈强化学习(RLHF)和AI反馈强化学习(RLAIF)。其中模型蒸馏能让小模型模仿大模型的决策逻辑、置信度等核心能力,实现10倍提速的同时仍保留95-98%性能;监督微调则重质不重量,1万条优质Agent交互数据优于数百万通用示例。而多数企业仍陷入“通用模型性能不足”与“定制成本过高”的两难。

亚马逊云科技的突破在于将这些高级技术自动化,今日正式发布的Reinforcement Fine-Tuning(RFT)in Amazon Bedrock,让普通开发者也能使用强化学习。操作极其简单:选择基础模型、指向Amazon Bedrock日志、选择奖励函数(如大模型评判器)即可完成;Amazon Bedrock会自动化整个RFT工作流,相比基础模型,准确性平均提升66%,效果十分显著。

对于需要更多控制的场景,今日发布的SageMaker AI Serverless Model Customization提供了两种体验:自助式体验适合喜欢掌控全局的开发者;Agent驱动只需自然语言描述用例,AI Agent会推荐微调技术、生成合成数据集、设置Serverless训练、评估模型效果。原本需要机器学习工程师数月的试错工作,现在只需几天,全程由懂最佳实践的Agent指导完成,且支持最新的强化学习技术,包括RLAIF、RLVR和DPO。

Swami博士还宣布了一项改变模型训练韧性的新功能:Checkpointless Training on SageMaker HyperPod。传统检查点恢复需回滚重试,导致资源闲置数小时;该功能通过持续保存分布式集群中的模型状态,实现分钟级恢复,硬件故障时可无缝替换设备、获取正确的节点状态,堪称范式转变。

Trust

可信Agent技术基石

Swami博士坦言,亚马逊云科技早期构建的Agent原型会有“模型在API调用时出现幻觉”的问题。这引发了一个根本性问题:如何让Agent真正可信?他指出,大语言模型会产生幻觉,在复杂规则面前出错或推理存在逻辑错误,一旦场景涉及金钱、信任等关键场景,单纯的统计方法远远不够。当人们不信任Agent时,往往会采取引入额外人工监督、硬编码每一个操作步骤的过度补偿措施,而这恰恰削弱了Agent本应具备的创造力与自主性。

为此,Swami博士特别邀请了亚马逊云科技杰出科学家、自动推理领域权威Byron Cook上台,Byron Cook开场就问了一个尖锐的问题:“你会把信用卡交给Agent吗?就像交给一个几岁的小朋友去购物一样,他可能会帮你买到你想要的商品,但最终你也可能得到一大堆你并不需要的东西。

Byron Cook详细讲解了神经符号AI(Neuro-Symbolic AI)的突破性方法,他解释说,自动推理是在数学逻辑中搜索和详细检查证明的学科,与2000年前欧几里得证明定理的方法相同。亚马逊云科技已经在内部系统中使用这项技术超过十年,现在将其应用于Agentic AI。

Byron Cook以三个生动的例子解释了如何将自动推理应用于AI Agent:

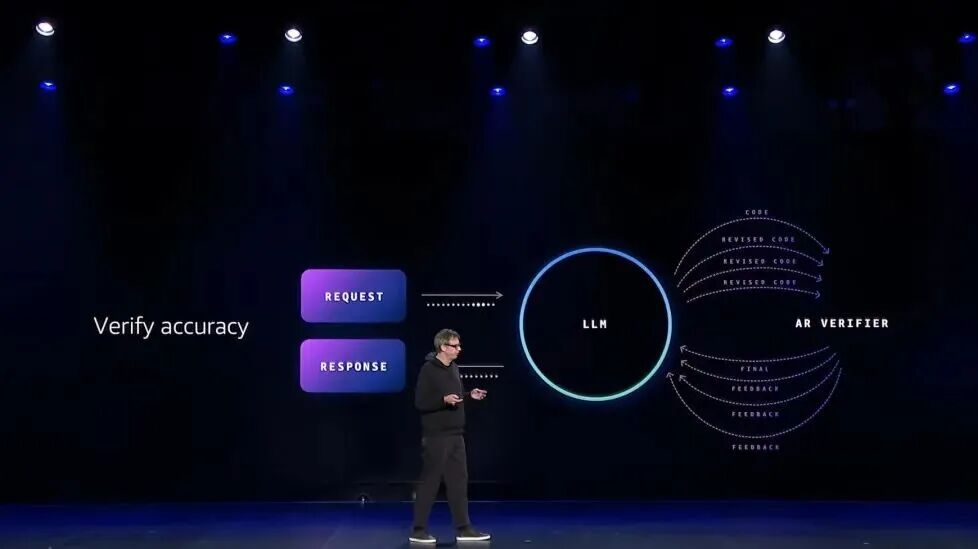

验证输出:就像学生做数学题,老师不仅看答案,还要检查每一步推导过程。在AI系统中,自动推理工具会像严格的数学老师一样,逐步验证大语言模型的推理过程,发现问题就推回重试,形成反馈循环。

训练数据生成:就像用标准答案的习题集训练学生。使用Lean定理证明器创建无限量的“标准答案”,让AI从一开始就学会正确的推理方式,让模型从小就养成“好习惯”。

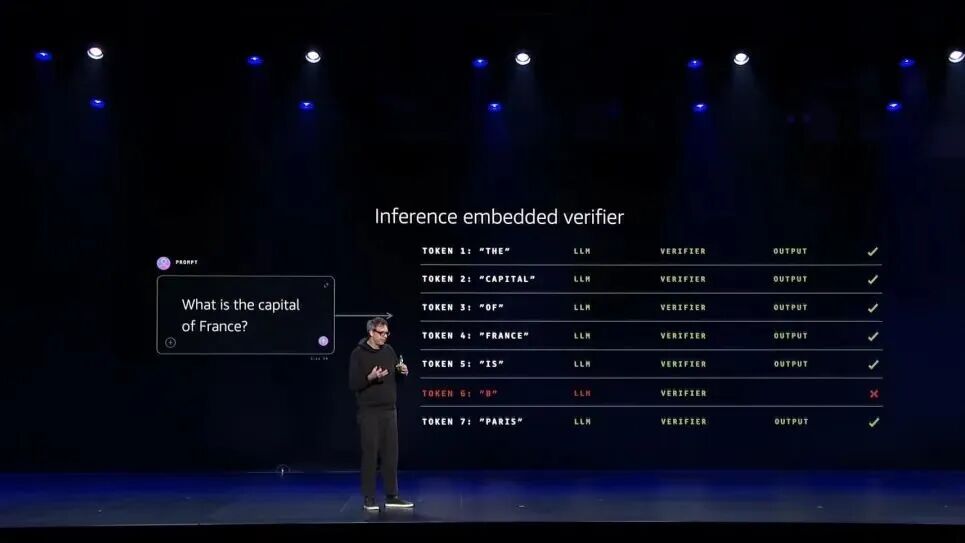

约束解码:就像汽车的车道保持系统,当你偏离车道时,方向盘会自动微调把你拉回来。在AI系统中,当模型试图回答“法国的首都是什么”并开始输出字母“B”时,自动推理系统会实时介入,像导航一样把它引导到正确的字母“P(Paris)”。这种实时纠偏确保了AI的输出始终符合逻辑规则。

Byron Cook还强调Kiro的规范驱动开发——Kiro可分析应用、识别验收标准并转换为规范,进而指导代码生成、测试生成,甚至证明程序正确性。他同时详解昨日发布的AgentCore Policy:只需用自然语言描述允许的操作,如阻止任何Agent在亚马逊云科技生产账户的资源上执行更新操作,系统会自动转为亚马逊云科技两年前开源,语义经Lean定理证明器形式化的Cedar策略语言,且这些策略可通过自动推理验证主权、隐私、安全等要求。Byron Cook总结:“形式化推理与生成式AI的结合,是构建可信Agent的游戏规则改变者。”

Reliability

生产就绪的可靠工具

Swami博士表示,企业需要“值得被信赖的Agent”,而非“能做事的Agent”。今天的Agent可能第一次完成任务,但重复执行时却会失败。问题根源在于传统机器人流程自动化(RPA)可靠但缺灵活性,大语言模型灵活但编排复杂,需要构建错误处理和回溯机制,可能导致大语言模型在失败路径上走很远才意识到错误。

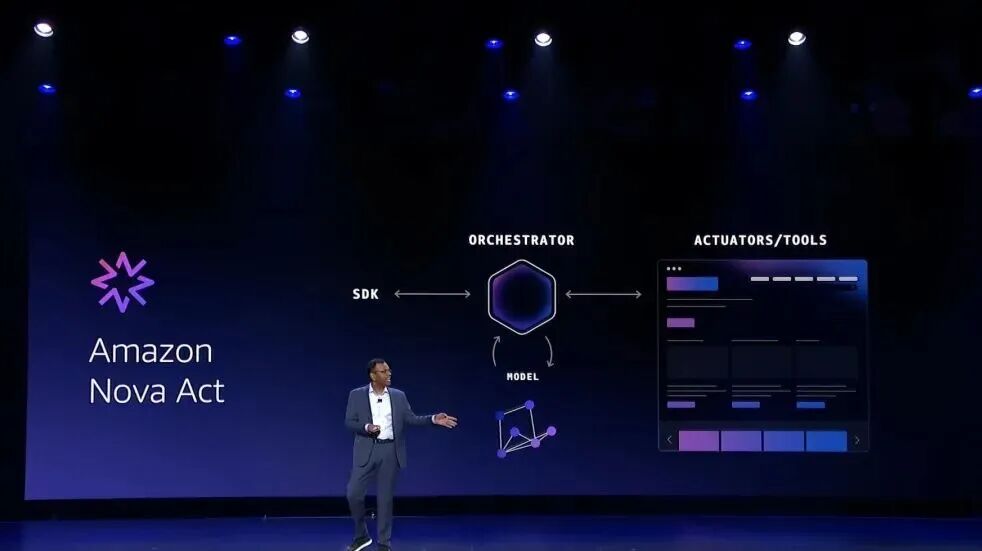

亚马逊云科技给出的破局方案,是将端到端集成与强化学习深度融合。今日正式可用的Amazon Nova Act,专为构建和管理自动化生产UI工作流的Agent团队而生,在企业级工作流场景中已实现90%的高可靠性。Swami博士解释说,Amazon Nova Act的独特之处在于紧密集成的组件——模型、编排器、执行器、SDK端到端优化。更关键的是端到端训练的理念:不是在“罐子里培养大脑”,而是让大脑和手脚一起训练,出厂就会走路。

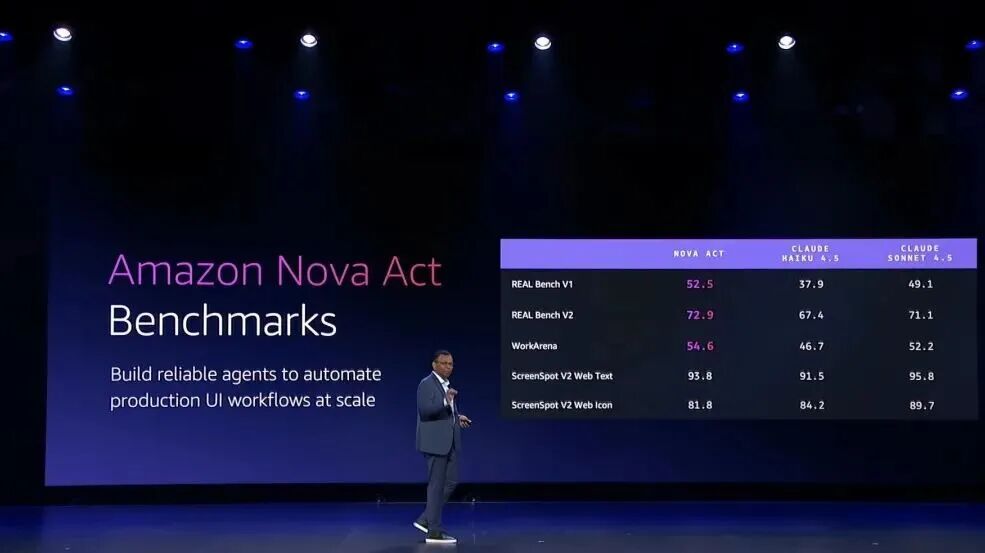

Swami博士详细解释了训练方法的创新。传统的模仿学习让Agent观察和模仿专家行为,但Agent永远不会理解行为的因果关系。因此,亚马逊云科技转向了强化学习,并创建了数百个强化学习“健身房”——复制真实企业环境,如CRM、HR系统、任务跟踪器等,的模拟环境。在这些“健身房”中,Agent运行数千个工作流,通过数十万次交互进行试错学习。每次成功完成任务获得奖励,每次失败获得惩罚。通过这种方式,Amazon Nova Act学会了可靠地解决真实世界的企业用例。在RealBench和ScreenSpot等关键基准测试中,Amazon Nova Act的表现与业界最佳模型相当或更好。

Collaboration

人机协作的Agent时代

阐述完四大核心技术支柱后,Swami博士特别邀请亚马逊云科技应用AI解决方案高级副总裁Colleen Aubrey登台。展示这些技术如何在实际客户服务场景中发挥作用。Colleen开场即抛出核心观点:“未来几年,‘Agentic teammate’将如同身边的同事一样必不可少。”

她强调,真正的效率不是“更少的努力”,而是“新产品、新服务、更好的客户体验和新商业模式”。而实现这一切的关键,是让AI成为团队的一部分,嵌入到每一个工作流中。

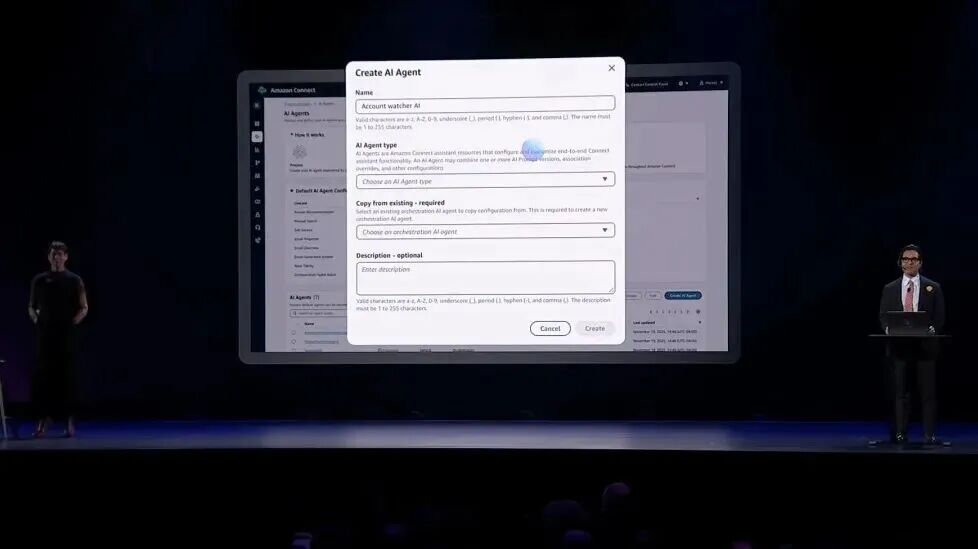

Colleen以Amazon Connect为例,这是一款云上的AI原生全渠道客户服务应用,沿用亚马逊内部同一技术,在全球范围内已支持数十亿次客户对话。她通过生动的现场演示,直观展示了人工客服代表与AI Agent无缝协作处理信用卡欺诈核查的完整流程。

在演示环节,Colleen将自己化身客户,当她发现账户上有多笔可疑交易时,AI Agent首先通过集成了Amazon Nova Sonic神经声音的自然语音对话验证身份,锁定实体卡但保留Apple Pay功能。当需要深入调查时,AI Agent将Colleen无缝转接给人工调查员Hector,并自动共享所有上下文信息,Colleen无需重复任何内容。

更令人印象深刻的是,Hector的“Agentic teammate”在几分钟内完成了通常需要数小时甚至数天的欺诈验证工作。AI Agent自动分析了交易的地理模式,在地图上标注出可疑位置,并开启跨其他案例查找模式,迅速确认这是一起ATM刷卡欺诈。Hector甚至现场创建了一个自定义Agent,用简单的自然语言提示定义其行为,让它持续监控Colleen的所有账户,一旦发现可疑活动就发送安全消息。

最后,AI Agent分析了Colleen的完整账户和交易历史,主动推荐了一个更安全的旅行账户,并指出她当晚在MGM Grand的晚餐预订可以享受更好的旅行奖励。整个过程流畅自然,展示了人类与AI的分析能力如何完美结合。

Colleen宣布,本周Amazon Connect发布了8项新的Agentic AI能力,包括Amazon Nova Sonic声音集成、实时推荐Agent、AI驱动的预测洞察以及多模态协作等核心功能,让人类客服与AI Agent能够真正成为无缝协作的团队。

Colleen总结道:“在未来几年,人和Agent结合的团队模式将从根本上改变工作方式。这不仅仅是把同样的事情做得更快,而是解锁我们甚至无法想象的能力。”

展望

自由创造的时代

Swami博士在演讲结尾回到了开场的主题。他说,还记得你第一次成功编写程序时的感觉吗?那种成就感、自由感、解锁新世界的兴奋感。今天,借助AI Agent,全球的建设者们每天都在体验这种感觉。无论你是在清理海洋、解锁人脑奥秘,还是解决尚未发现的挑战,你都拥有了构建的自由、从概念到影响的空前速度、解决看似不可能问题的自由。

亚马逊云科技正通过“易于构建、高效、可信、可靠”四大支柱让每个人都能构建并运行生产级AI Agent。未来并非Agent能做所有事,而是我们能全然依赖它们做事。让我们共同构建这一令人惊叹的未来!

来源:至顶网CIO与CTO频道

好文章,需要你的鼓励

CIOs将AI采纳列为首要任务:调查报告

最新调查显示,近半数CIO将AI采用和自动化提升列为未来五年的首要任务。超过三分之一的受访者将加强业务连续性和灾难恢复作为重点,同等比例的企业将人才技能发展列为优先事项。尽管AI投资成为焦点,但投资回报率仍不明朗,近三分之二的商业领袖估计AI投资回报率仅为50%或更低。

微软亚洲研究院联手清华大学:让AI看图不再“雾里看花“的双向感知新技术

微软亚洲研究院与清华大学联合提出双向感知塑造技术,通过创新的两阶段训练方法解决AI视觉理解中的关键问题。该技术让AI学会正确聚焦重要视觉信息,避免被无关内容误导。仅用1.3万训练样本就在八个基准测试中平均提升8.2%性能,超越使用数十万样本的专门模型,为AI视觉推理能力提升开辟新路径。

红帽收购Chatterbox Labs加强AI治理能力

红帽公司宣布收购伦敦AI公司Chatterbox Labs,该公司专注于模型测试和生成式AI护栏技术。此次收购将为红帽AI产品组合增加自动化AI风险评估、安全测试和治理功能。Chatterbox Labs的AI风险指标帮助企业验证数据和模型是否符合国际法规,提供模型无关的稳健性、公平性和可解释性测试。收购将增强红帽的AI安全能力,包括生成式AI护栏、模型透明度和预测性AI验证等功能。

上海交大团队突破大语言模型实时推理难题:让AI在时间限制内既快又准

上海交通大学研究团队开发了TimeBill框架,解决大语言模型在实时应用中的时间不确定性问题。该系统通过精确预测回答长度和执行时间,动态调整AI记忆管理策略,确保在规定时间内完成任务的同时保持回答质量。实验显示TimeBill在各种时间预算下都能实现最佳的完成率与性能平衡,为AI在自动驾驶、工业控制等安全关键领域的应用提供了重要技术支撑。

通往数十亿Agents的未来!re:Invent 2025 Matt Garman主题演讲精华!

Trainium3+Graviton5打出组合拳,Lambda迈入可控时代

Agentic AI军备竞赛升级!亚马逊云科技亮出“底牌”,定义下一条赛道

2025 re:Invent :亚马逊云科技把Agentic AI生态梳理明白了

汇丰PayMe成功迁移至亚马逊云科技 加速推动香港电子支付创新

亚马逊云科技与OpenAI宣布达成多年战略合作

亚马逊云科技的“AI毛坯房”,能解决游戏出海80%需求吗?

亚马逊云科技第三期创业加速器圆满收官 助力初创释放Agentic AI潜力 加速全球化进程

AI革新制造业:产品力、品牌力与精益运营的三维进化论

更多“厨师”、更快“出餐”:Graviton4的性价比账单