Gartner发布2024年数据与分析重要趋势

Gartner公司发布了2024年数据与分析(D&A)重要趋势,这些趋势正在带来包括组织、人事问题在内的各种挑战。

Gartner高级研究总监方琦表示:“AI的力量以及日益重要的生成式AI正在改变人们的工作方式、团队协作方式和流程运作方式。在这场技术变革中,未能成功实现转型并有效利用D&A,特别是无法有效利用AI的企业机构,将难以取得成功。”

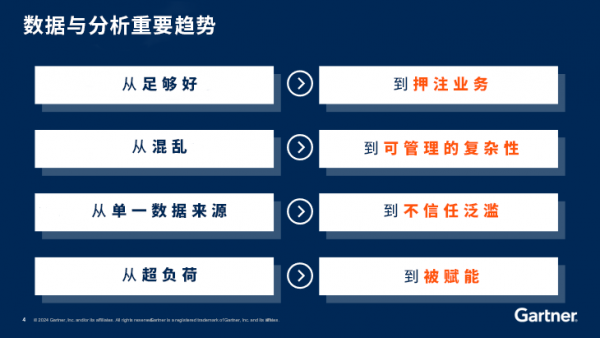

在近日的Gartner数据与分析峰会上,Gartner分析师介绍了IT领导者必须把握并纳入其D&A战略的重要数据与分析趋势(见图一)。

图一、2024年数据与分析重要趋势

资料来源:Gartner(2024年4月)

趋势 1:押注业务

随着AI不断推进各行各业战略层面上的变革,D&A领导者必须展现出“押注AI业务”的技能并赢得信任,才能领导企业内部的AI战略。

方琦表示:“D&A领导者必须将他们正在开发的能力与其为了实现企业机构所需业务成果所做的工作挂钩,以此展示他们对企业机构的价值。如果做不到这一点,那么资源分配不当、投资利用不足等问题将继续升级,企业机构也不会将领导内部AI战略的重任交给D&A。”

由于AI正在改变企业的运营方式,企业将面临一场成本灾难。D&A领导者必须采取行动落实财务运营(FinOps)实践,以此建立和执行标准并减少支出。

Gartner预测,到 2026 年,如果首席数据和分析官(CDAO)能够成为首席财务官在创造业务价值方面值得信赖的顾问和合作伙伴,那么D&A将升级为推动企业战略增长的动力。

趋势2:可管理的复杂性

许多D&A系统都很脆弱,并且它们的冗余会造成混乱和增加成本。方琦表示;“领先的企业正在努力将这种混乱转化为可管理的复杂性。复杂性本质上不易应对,但认识到这一点能够切实了解环境的动态变化,帮助D&A团队采取适当的行动。”

为了管理复杂性,D&A领导者需要利用AI工具实现生产自动化和提高生产力,包括投资于数据管理的加强、决策自动化以及像自然语言处理(NLP)这样的分析能力。Gartner预测,到2025年,CDAO将把数据编织视为成功应对数据管理复杂性的主导因素,把重点放在增值的数字业务优先事项上。

趋势3:取得信任

随着生成式AI可及性和效率的日益提高,如何应对这个数据可靠性不断受到质疑的世界已变成一大难题。企业内部信任缺乏、对数据价值和质量的担忧以及围绕AI的法规正在导致不信任泛滥。

方琦表示:“不可信的数据可能无法用来作出决策”。

“D&A领导者应使用决策智能实践来建立对数据的信任并监视决策过程和结果。此外,为了取得利益相关方的信任,落实有效的AI管理和负责任的AI实践至关重要,例如建立数据的AI就绪性,也就是说数据要符合道德规范、安全、无偏见并且丰富到能够做出更加准确的回答。”

趋势4:被赋能的员工

方琦表示:“将AI应用于D&A必须能够赋能员工,而不是让他们感到受到威胁或沮丧,这一点十分重要。”

企业机构必须投资于培养员工的AI素养、使用具有适应能力的治理实践实现有效的治理并落实基于信任的信息资产管理办法,帮助个人知晓他们所使用的信息的出处。

方琦表示:“AI培训的重点不止是人数,还需要采取不同的方法。企业机构要认识到专家级AI用户所需具备的技能将与其他用户截然不同。Gartner预测到2027年,由于企业未能从生成式AI中获得预期的价值,半数以上的CDAO将获得数据素养和AI素养项目的资金。”

好文章,需要你的鼓励

谷歌Project Genie新增街景功能,带你探索真实世界

谷歌宣布为旗下互动世界构建工具Project Genie新增Google街景功能,用户可基于真实地点生成可探索的游戏世界。只需选定美国境内的地图位置,描述角色形象,并选择"沙漠"或"石器时代"等风格,系统即可生成与现实街景绑定的沉浸式虚拟场景。每次游玩时长限60秒,支持WASD操控,目前仅向AI Ultra订阅用户开放,后续将逐步扩展覆盖范围。

新加坡国立大学发布首个视频“潜台词“理解基准测试:AI究竟能不能读懂视频背后的弦外之音?

新加坡国立大学构建了首个视频隐喻理解基准ViMU,含588段视频与2352道题,测试16个主流AI模型均未超过50%,揭示AI在视频潜台词理解上的系统性短板。

手机上的“氛围编程“时代正式来临

随着AI编程工具的普及,越来越多的非开发者开始尝试自己构建应用。谷歌在I/O大会上宣布,AI Studio新增功能可让用户通过提示词快速生成原生Android应用,并直接导出到手机。此外,谷歌还推出了基于Gemini的自定义小组件功能,并提出"生成式UI"概念,让手机界面根据需求实时生成。与此同时,苹果据报道也在探索通过提示词创建快捷指令的功能,手机个性化体验或将迎来新突破。

浙江大学联合多所顶校:让AI真正“看懂“360度全景图,机器人导航和视觉搜索迎来新突破

浙江大学等机构联合提出PanoWorld,通过球面空间交叉注意力和57万张全景图训练数据,让AI能直接理解360度全景图的空间结构,在导航和视觉搜索任务中大幅超越现有方法。

Google 在 Colab Python 平台推出免费的 Gemini 驱动数据科学助手

Gartner:IT预算下降与AI崛起,CIO要成为“数字先锋”

Gartner:中国企业弥合基础设施和运营内部云技能差距的三大举措

Gartner发布2025年及未来中国企业实现AI价值的重要预测

SAP Business Suite 重启计划引发用户关注

Anthropic 经济指数 — 企业领导者必知的 10 大 AI 工作场所趋势

TigerGraph 升级图数据库产品,实现更快部署速度和全新预配置方案

AI 数据公司主导 BestBrokers 最新独角兽企业榜单

Gartner:中国企业优化云原生投资的三大策略

Gartner:使用国产基础设施软件,避免业务中断风险