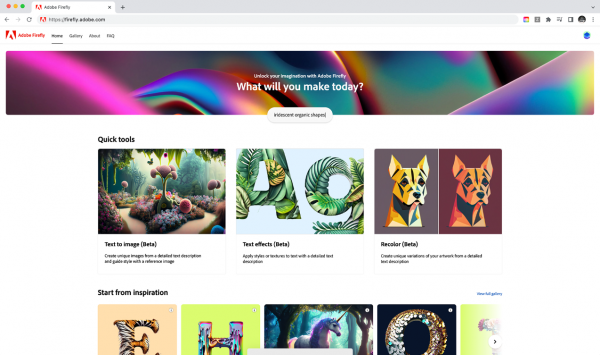

Adobe全新创意生成式人工智能Firefly重磅亮相

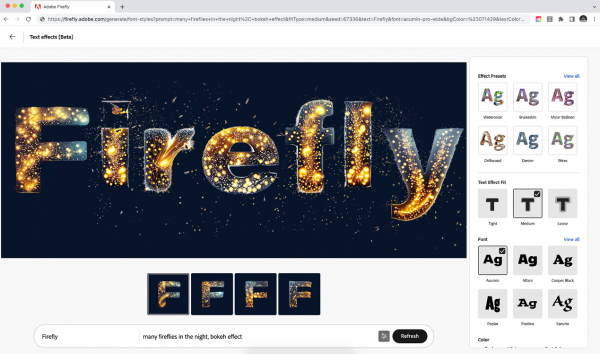

Adobe(Nasdaq:ADBE)推出全新的创意生成式人工智能(AI)模型集 Firefly,将首先聚焦于图像生成和文本效果。Firefly将让Creative Cloud、Document Cloud和Experience Cloud工作流程中的内容创作和修改变得更精准、更强大、更快速和更轻松。Firefly将成为跨Adobe 云端产品的全新Adobe Sensei生成式AI服务的一部分。

Adobe在 AI 创新方面拥有超过十年的历史,通过Adobe Sensei 将数百种智能功通过应用程序提供给数以亿计的客户。得益于Photoshop中的神经网络滤镜(Neural Filters)、After Effects 中的内容感知填充 (Content Aware Fill)、Adobe Experience Platform 的Attribution AI(人工智能归因),以及Acrobat 的Liquid Mode等功能,Adobe的客户可以以更强大、更精准、更快速和更轻松的方式,创作、编辑、衡量、优化和审阅数十亿条内容。这些创新功能的开发和部署均符合Adobe负责任、有承担和高度透明的 AI 道德原则。

Adobe 数字媒体业务总裁 David Wadhwani表示:“生成式人工智能是由AI主导的创造力和生产力的下一个演变,让创作者和计算机之间的对话变得更自然、更易用和更强大。借助 Firefly,Adobe 将把AI 驱动生成的‘创意成分’直接引入客户的工作流程,提高所有创作者的生产力和表达力,从顶端的创意专业人士到大范围的创作者经济均能受益。”

Adobe Firefly:赋予创作者新的超能力

Adobe 正在设计的Firefly为所有创造者都赋予了“超能力”,让他们的工作速度如想象一般快速。在Firefly的支持下,无论是何种经验和技能水平的内容创作者,都能按自己的语言生成理想的内容,从图像、音频、矢量图、视频和3D到诸如画笔、色彩渐变和视频转换等创意成分,都比以往任何时候更快捷、更轻松。有了Firefly,创作者可以不受限制地制作多样化的内容,并基于品牌形象快捷、简单地进行多次修改。Adobe还将Firefly直接整合至其行业领先的工具和服务中,确保用户可以毫不费力地在其现有的工作流程中应用生成式人工智能所带来的强大力量。

Adobe 今天还推出了Firefly的测试版,展示拥有不同经验和技能水平的创作者如何生成高质量的图像和一流的文案效果。Adobe 认为,如果没有强大的想象力来推动,技术就无法发挥其威力。通过测试,Adobe将与创意社区和客户沟通,在发展这个颠覆性技术的同时,开始将之整合至旗下的应用程序中。首批与Firefly整合的应用程序将会是Adobe Experience Manager, Adobe Photoshop 和 Adobe Illustrator。

专为商业用途安全使用的高质量图像

Firefly 将由多个模型组成,为具有广泛技能和技术背景的客户提供服务,适用于不同的应用场景。Adobe的第一个模型是基于Adobe Stock素材库、公开许可内容和版权已过期的公共领域内容训练的,将专注于图像和文案效果,旨在生成可安全用于商业用途的内容。Adobe Stock 拥有数以亿计的专业级且获许可的图像,是市场上具备高质量素材的图像库之一,有助于确保 Firefly 不会根据其他人或品牌的 IP 生成内容。未来的 Firefly模型将运用来自 Adobe 和其他公司的各种资产、技术和培训数据。在发展其他模型时,Adobe 将继续将应对潜在的有危害性的偏见作为优先考虑事项。

以客户为本方针

Adobe 正在设计生成式人工智能,以助力创作者从他们的技能和创造力中获益:

- 帮助创作者高效工作:内容正在推动全球经济发展,创造力和设计的受重视程度前所未有。Adobe 最近一项研究显示,88%品牌认为内容需求在去年至少增加一倍,三分之二的品牌预计在未来两年内将增长5 倍。Adobe 正在利用生成式 AI 来减轻内容创作的负担,通过解决方案更快、更智能、更方便地协助创作者工作,包括让客户能够使用自己的创意素材训练Firefly,以个人风格或品牌语言生成内容。

- 回馈创作者:Adobe希望以一种能够帮助客户将创意变现的方式构建生成式AI,就像Adobe Stock 和 Behance一样。Adobe 正计划为Stock的内容贡献者开发一种获得收入的模式。一旦 Firefly测试结束,我们将分享有关贡献者如何获得报酬的详细信息。

- 倡导开放标准:Adobe 创立的内容真实性倡议(CAI)建立了可信数字内容归属的全球标准。该倡议在全球拥有 900 多名成员,其作用从未像现在这样重要。Adobe 正在借助CAI的开源工具推动开放的行业标准,这些工具是免费的,并通过非盈利性质的内容来源和真实性联盟(C2PA) 积极开发而成。 这一倡议的目标包括推出通用的“Do Not Train”内容凭证标签,创作者可以将其纳入图像的内容凭证中,要求其内容不用于训练模型。无论这些内容在何处使用、发布或保存都将与这一标签保持关联。 此外,人工智能生成的内容也将被相应标记。

- Firefly生态系统:Adobe还计划在各平台上以API的方式提供Firefly,让客户能够将其集成到自定义工作流程和自动化中。

来源:至顶网CIO与CTO频道

好文章,需要你的鼓励

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

机器人智能公司Inbolt将于2026年6月在芝加哥Automate展会上发布两项新能力:Inbolt机器人编程功能和扩展版机器人控制模块。新功能可让工程师直接基于CAD模型构建程序,结合视觉模型实时定位实体零件并自动调整运动路径,彻底消除传统调试中耗时数周的手动示教环节。此次更新还将原生支持安川机器人,使平台覆盖品牌扩展至六个。

浙江大学团队研发:AI机器人能否像人一样“找准角度“拍出同款照片?

浙江大学团队提出目标视角复现任务(TVR),测试AI主动导航至指定视角的能力,最强模型成功率仅12%,人类达93%,并验证了视觉示范学习与多轮强化学习的提升路径。

笔记本电脑深度清洁指南:内外兼修焕然一新

本文提供了一套完整的笔记本电脑深度清洁方案。硬件方面,介绍了如何用温和洗涤剂清洁机身、用微纤维布擦拭屏幕、用压缩空气清理键盘及清洁充电线的正确方法。软件方面,建议及时更新操作系统与驱动程序,删除冗余文件与临时下载内容,并通过开启Windows Storage Sense功能实现自动清理,同时将剩余文件整理归类,保持系统整洁高效运行。

香港城市大学与快手团队联手:让AI“导演“教会视频生成模型真正“思考“

这项研究提出"VLM即教师"框架,让视觉语言模型在视频生成推理时充当实时监考官,通过可微分奖励信号在线优化轻量LoRA模块,平均提升视频推理性能16.7分。

AI驱动网络犯罪数量飙升,勒索软件受害者年增389%:Fortinet 发布2026年全球威胁态势研究报告

Inbolt将在Automate展会发布视觉驱动机器人编程新功能

笔记本电脑深度清洁指南:内外兼修焕然一新

加利福尼亚州城市通过全美首个由选民投票决定的数据中心禁令

柴油替代方案:AI数据中心如何利用燃气引擎与蒸汽涡轮供电

AI定义汽车时代,车载以太网可靠性面临全新挑战

安全算法的持续更新正变得愈发困难

轨道数据中心本质上是功能强化的卫星

Infineon Live Lab正式发布:全球首个实时云端实体硬件评估平台

Serve Robotics携手NoScrubs,自主配送机器人跨界拓展洗衣服务

Workr Robotics CEO:工业机器人自动化应按小时付费

专访CreateMe CEO:从缝纫到粘合,实体AI如何重塑服装制造

亚马逊云科技携手Adobe为品牌提供Adobe Experience Platform解决方案,以深刻洞察提升客户体验

让Sora帮忙剪片?Adobe为Premiere Pro引入生成式AI工具

前CEO谈Figma未能卖给Adobe之后的新生活

身陷监管泥潭,Adobe斥资200亿美元对Figma的收购仍寸步难行

Adobe升级Photoshop的生成式AI模型 并为Illustrator和Express加入更多功能

有意见 | “Adobe之父”去世,他掀起了桌面印刷革命

Adobe用颠覆性的创新,赋能体验为先的增长

有意见 | Adobe发力生成式AI,一句话P图不是梦

Adobe全新创意生成式人工智能Firefly重磅亮相

竞争加剧,微软和Adobe发布AI图像生成工具