环信移动客服品牌升级客户互动云,20万增值礼包免费送!

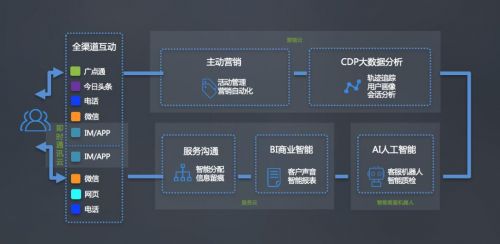

2017年8月,环信移动客服品牌全面升级为环信客户互动云(Customer Engagement Cloud)。环信客户互动云——全媒体智能客户互动中心倡领者。环信客户互动云整合了环信全球领先的即时通讯云、服务云、智能客服机器人和营销云产品线,通过人工智能和大数据赋能,为企业提供从客户互动渠道,到客户服务,再到精准营销的全流程客户互动解决方案。帮助企业优化运营,精准营销,提高客户服务体验。

环信客户互动云:从用户互动渠道到客户服务再到用户营销完整闭环

环信客户互动云在经历了48个版本的迭代以后,在包括产品易用性、稳定性、增值服务多样性等方面均有质的飞跃,为了给客户创造更好的功能体验,原有环信移动客服产品全面升级为环信客户互动云。同时,将于8月17日开启环信金秋有礼,价值20万十大增值服务大礼包(视频客服、主动营销、客户声音...)免费送活动,登录环信官网(www.easemob.com)即可参与!

活动内容详情:

1. 单次购买(新购、续约、扩容)3个及以上客服坐席(标准版/旗舰版),即赠送价值10W/20W 十大增值服务大礼包一个(有效期3个月)。

2. 为了满足广大企业客户更便捷员工管理的需求,客服坐席费用将按最大启用坐席(无限创建坐席模式)以租户内同时可在线坐席数为准模式收费。旗舰版4800元/年,标准版1800元/年(活动期间将按照折扣价格1500元/年执行),新服务价格体系将于10月1日开始正式执行,先到先得。

3.活动日期:2017.8.17——2017.9.30

礼包详情:

A 财源滚滚礼包(10万)

1、主动发起会话:查看正在访问网站的访客,并选择优质访客发起会话(需提供网站URL)。

2、访客轨迹:收集访客浏览轨迹,显示在会话窗口里,帮助判断客户的兴趣范围及产品爱好。

3、全站访客统计:洞悉访客来源,可视化网站流量、全站访客轨迹等。

4、视频客服:由访客发起,与坐席1对1视频沟通。

B 满分客服礼包(10万)

1、显示排队人数:支持在网页端聊天窗口显示当前排队人数。

2、坐席消息预知:网页端客户聊天时,在会话面板显示客户的输入状态及正在输入的内容。

3、消息撤回:APP、网页渠道,可以撤回2分钟内的聊天消息。消息撤回后,将在APP、网页访客端消失。

4、视频客服:由访客发起,与客服1对1视频沟通,更加形象的解决用户问题。

C 十全十美礼包(20万)

1、主动发起会话:查看正在访问网站的访客,并选择优质访客发起会话。

2、视频客服:由访客发起,与客服1对1视频沟通。

3、关键字匹配:关键字匹配,系统自动回复一条消息,帮助客服和机器人更加灵活、快速、准确地解答客户的问题。

4、主动营销:整合用户信息,自动联系到站用户,增加访客线索,提高推广效果。

5、客户之声:通过自然语言解析,主题聚类,情感度分析等技术手段挖掘和分析热点话题,支持每日热门关键词查询和筛选,可手动添加自定义关键词,查看客户情感趋势及全局关键词分布,可查看具体关键词详情、导出会话消息并对具体会话进行回呼,可停用无需关注的关键词。

活动细则:

• 活动期间内在线支付、线下购买客服坐席均可参与,每个租户只可以参加一次。

• 付款后,即可发送礼包登记邮件,我们会在5个工作日内受理。

• 用户付款后需在7日内申请礼包,逾期未申请视为放弃礼包资格

• 礼包内容不可更改。

• 礼包有效期以礼包开通之日起开始计算,有效期3个月。

• 活动过程中,如出现以下行为(如拆分下单、领取礼包后退款、虚假购买等),环信有权自动取消活动礼包,本次活动环信具有最终解释权。

参与活动:http://www.easemob.com/event/cec_gift

来源:业界供稿

好文章,需要你的鼓励

美国三大运营商携手卫星技术,向信号盲区宣战

AT&T、Verizon和T-Mobile宣布计划组建合资企业,利用卫星技术消除美国境内的网络覆盖盲区,重点服务农村及网络欠发达地区。该合资企业将整合知识产权与地面频谱资源,推动下一代直连设备(D2D)通信发展。目前三方尚未签署正式协议,现有运营商与卫星服务协议不受影响。此前,T-Mobile已与SpaceX合作推出星链卫星服务,美国联邦通信委员会也刚批准了价值400亿美元的EchoStar频谱出售案。

AI助手越权了?南加州大学等机构揭示大模型代理的“权限失控“问题

FORTIS是专门测量AI代理"越权行为"的基准测试,研究发现十款顶尖模型普遍选择远超任务需要的高权限技能,端到端成功率最高仅14.3%。

Flytrex无人机携手达美乐,可一次性送达两个大号披萨

无人机食品配送服务商Flytrex与全球知名披萨连锁品牌Little Caesars宣布合作,推出全新Sky2无人机,最大载重达4公斤,可一次配送两个大披萨及饮料,满足全家用餐需求。Sky2支持最远6.4公里的配送范围,平均从起飞到送达仅需4.5分钟。首个试点门店已在德克萨斯州怀利市上线,并实现与Little Caesars订单系统的直接集成。

荷兰Nebius团队:给AI“起草员“瘦身,大模型推理速度最高提升5倍的秘密

荷兰Nebius团队提出SlimSpec,通过低秩分解压缩草稿模型LM-Head的内部表示而非裁剪词汇,在保留完整词汇表的同时将LM-Head计算时间压缩至原来的五分之一,端到端推理速度超越现有方法最高达9%。

Flytrex无人机携手达美乐,可一次性送达两个大号披萨

欧洲最大3D打印公寓楼提前数月竣工

彼亚乔携手迪士尼推出Grogu主题自主跟随货运机器人

Okta将AI智能体安全管理扩展至Amazon Bedrock并向第三方身份提供商开放

苹果13英寸iPad Pro Magic键盘键盘亚马逊历史低价,直降25%

WhatsApp iOS版Liquid Glass界面设计正式向更多用户推送

OpenAI为ChatGPT Pro推出个人财务管理新功能

赛格威全新Xaber 300电动越野摩托车正式开售,最高时速达96公里

OpenAI再度重组高管架构,全力押注AI智能体战场

出门在外也能用!OpenAI 将 Codex 接入 ChatGPT 移动端

Google Gemini应用图标迎来细微配色调整

Synetic在2026嵌入式视觉峰会上发布LYNX计算机视觉SDK